Зачастую в роликах о создании игр можно увидеть облепленных с ног до головы датчиками людей в чёрных трико. Кто-то из этих смешных ребят — популярнейшие актёры, а кто-то чаще так и остаётся за кадром. Но заняты они одним общим делом — захватом движений. Их трудами 3D-модели приобретают живые мимику и движения. Но почему бы всё это не анимировать в каком-нибудь Blender, зачем такие сложности? Как вообще работает эта странная система, когда её впервые придумали, и в чём её профит? На все эти вопросы у меня есть ответы.

От срисовки к копирке

Ещё в прошлом веке разработчики поняли, что для самого качественного подражания настоящим людям нужно брать этих самых людей за основу. Например, в ранних Mortal Kombat для создания аватаров персонажей обрисовывали фото реальных людей, снятых на фоне хромакея.

В DOOM эмоции героя в интерфейсе делали руками, не тратя время на плавность и реалистичность. Прежде всего нужно было, чтобы рожица была понятна, может, даже по-мультяшному выразительна, а то, как там она уже соответствует реальности, думать не приходилось. Необходимости не было, да и когда дерёшься с демонами, не досуг заглядываться.

Дотошная реалистичность этим играм ни в движениях, ни в эмоциях пока не требовалась, но это был лишь вопрос времени. Так и началась история Motion Capture.

Сначала было ротоскопирование. Но оно было вот прямо совсем сначала. Изобрели его в 1915 году, а впервые применили в «большом кино» в 1939 году в мультфильме «Белоснежка и семь гномов». Ротоскопирование представляет собой покадровую обводку живых съёмок с помощью стеклянного стола с проекцией. Технологию использовали для более плавной картинки, и она отнимала огромное количество времени. Для примера, первая короткометражка, созданная при помощи ротоскопирования, длилась всего одну минуту, но потребовала 2600 кадров и целый год работы. Однако тогда это был единственный способ имитировать реальные человеческие движения, который, возможно, и задал вектор развития Motion Capture.

Двадцать лет спустя Ли Харрисон III прикрепил регулируемые резисторы на специальный костюм и впервые сумел захватить движения актёра в реальном времени на ЭЛТ-экране. Никаких сложных действий актёр не совершал, но это уже был невероятный прорыв, который открывал широчайшие перспективы.

В 1970-х вклад в развитие технологии внесли врачи-кинезиологи, которые по долгу службы изучают и лечат человеческий опорно-двигательный аппарат. К телам пациентов стали крепить потенциометры. С их помощью данные о движениях поступали в компьютер, и тот визуализировал действия на экране.

К девяностым годам в кино уже вовсю использовались полноценные костюмы с маркерами, которые отслеживали огромные камеры. До мельчайшего захвата мимики пока было далеко, однако на выходе уже получалась похожая на правду картинка. Правда, в каждом кадре приходилось вручную указывать место отдельного маркера, так что удобство метода стояло под большим вопросом. Но это уже было в разы лучше, чем руками анимировать каждое движение созданной модели.

Пока в кино уже восходила звезда Энди Серкиса, игровая индустрия только примерялась к новому методу. В 1989-м году создатель «Принца Персии» Джордан Мехнер снял несколько часов видео, в которых его младший брат бегал, прыгал, подтягивался и фехтовал. Затем Мехнер перенёс движения своего брата в игру с помощью всё того же ротоскопирования.

Через несколько лет французская студия Delphine Software International применила ротоскопирование в создании Another World и Flashback, которые считаются культовыми. А чуть позже Remedy Entertainment использовала эту же технологию в создании лицевых анимаций для Max Payne.

Но технологии не стояли на месте, способы мокапа совершенствовали. К настоящему моменту Motion Capture полноценно используют в кино уже почти тридцать лет. Играм пришлось раскачиваться чуть подольше. Первыми проектами с использованием мокапа считаются файтинги Virtua Fighter 2 (1994) и Soul Edge (1995). А в 1999-м вышел дебютный проект французской студии Quantic Dream — Omikron: The Nomad Soul — в котором впервые в игровой индустрии Motion Capture использовался для захвата мимики актёров. К слову, в нём же были оцифрованные концерты самого Дэвида Боуи.

Как это работает?

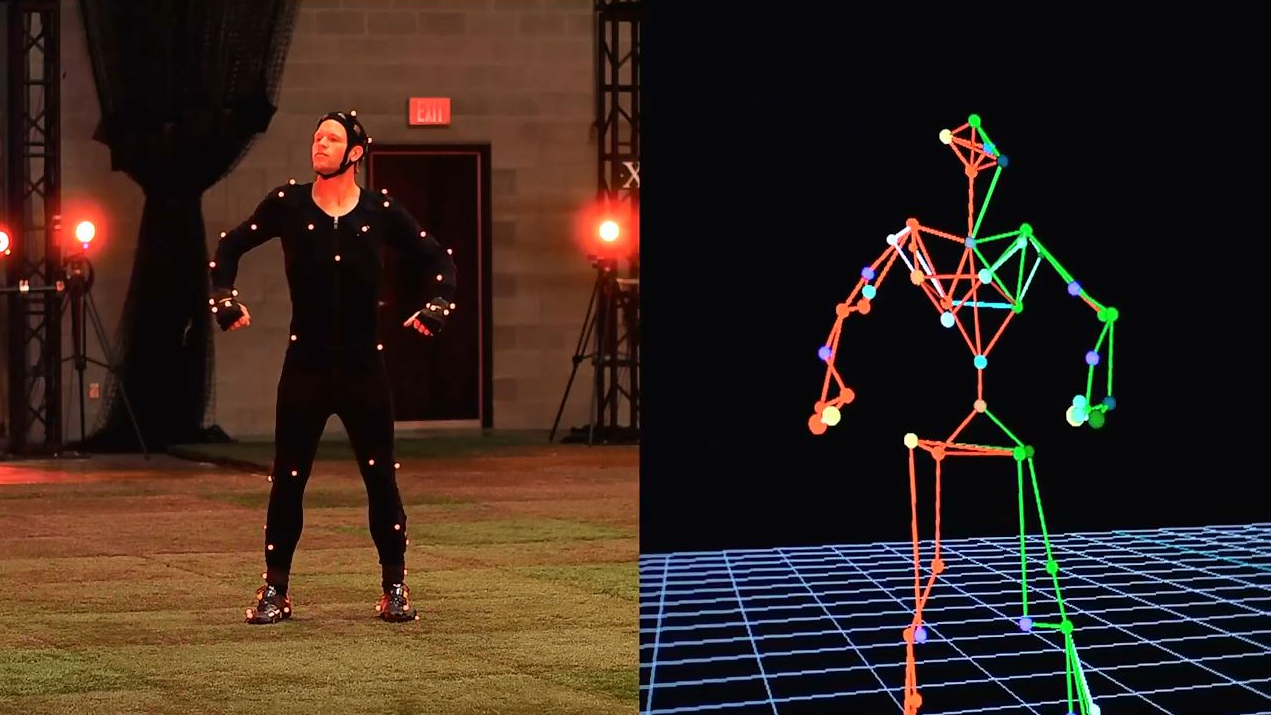

Наполнять игровых персонажей жизнью не так-то просто. Расположенные на костюме актёра датчики считываются камерой. Затем программа визуализирует действия человека с помощью «скелета», состоящего из костей — шарниров для движения модели. Такие скелеты есть внутри каждой анимированной 3D-модели, и неважно, придавали ей движения с помощью мокапа или вручную.

Основных видов захвата движений два, и основываются они на том, каким способом идёт передача движений актёра к визуализатору. В одних инфракрасный свет посылается на датчики-маркеры, отражается от них и возвращается в объективы камер (далее специальные программы рассчитывают положение датчиков в пространстве). Такие системы называют оптически-пассивными. А есть те, в которых вместо маркеров применяют светодиоды. У каждого из них есть собственное «имя», по которому система опознаёт его расположение в пространстве и синхронизирует с нужной костью на модели. Это оптически-активная система, и в ней благодаря индивидуальным идентификаторам у каждого датчика реже происходит путаница.

Кроме того, сегодня используют магнитные системы, в которых положение маркеров вычисляется по искажениям магнитного потока, и гироскопические, которые передают данные напрямую компьютерам. У каждой из этих систем нашлись свои нюансы и сложности работы: для корректного захвата движений при их использовании нужно создавать практически стерильные условия. Так, магнитным системам мешает проводка и арматура в основе здания, а гироскопические требуют огромного количества проводов.

В начале века появилась Performance Capture. Она позволяет одновременно захватывать как движения тел актёров, так и их речь и мимику. Для этого на лица стали крепить усовершенствованную систему датчиков. Сначала технология из-за сложности и дороговизны применялась только в киноблокбастерах, но со временем её потихоньку начали осваивать и игровые студии. Только те, которые могли себе это позволить.

Но не всегда для захвата мимики актёрам нужно облепливаться датчиками с ног до головы. Существует технология безмаркерного захвата эмоций, которая автоматически распознает человеческое лицо. Спасибо за неё можно сказать Rockstar Games, которые целых семь лет ваяли её для L.A. Noire.

В игре мимика героев играла ключевую роль, ведь в том числе по ней игрокам предстояло догадываться о том, кто говорит правду, а кто её приукрашивает. Стандартной технологии захвата движений для их запросов не хватало, так что большие шишки студии Team Bondi собрались вместе, покумекали и решили переделать, а точнее, создать снова Motion Scan.

По итогу система переносила выражение лица актёра на модель персонажа достаточно чётко и реалистично, чтобы разработчики были этим удовлетворены. Вот только понадобилось для этого создать монструозную шайтан-машину с 32 камерами HD-разрешения, которые снимали лицо человека с 32 ракурсов в 30 кадров в секунду. Все изображения передавали на компьютер, и софт уже собирал это всё воедино.

Но так работало только с мимикой, поэтому для L.A. Noire лица актёров писали с помощью Motion Scan отдельно, а тела и движение в пространстве — уже с помощью Motion Capture. Из этого впоследствии выросла довольно закономерная проблема: тела персонажей в игре как будто существовали отдельно от головы. Плюс к этому актёру нужно было записываться в гриме, да и стоило всё это дело порядочных денег. Это привело к тому, что в итоге широкой популярности этот способ захвата мимики актёров не сыскал.

Зато альтернативой множеству датчиков на лице послужила конструкция, в которой была всего одна камера. Она располагалась очень близко к лицу на специальном обруче и захватывала мимику в режиме реального времени. Так создавали анимации для Mafia 3 и Injustice 2.

Сейчас мы имеем некий синтез всех этих способов: датчики на лице так и остались, но стали поизящнее. Их количество варьируется в промежутке от 80 до 200. Камера на обруче перед лицом ориентируется на них и записывает мимику в реальном времени, а датчики на костюме передают информацию о движениях тела. При это игровые движки научились сами достраивать движения при потере маркера из вида и визуализировать цельную картинку ещё на этапе съёмок. А благодаря некоторым инерционным системам уже даже не обязательно записывать мокап в студиях.

Вот только это всё ещё не финал. После длительных смен захвата движений настаёт черёд аниматоров, которые дорабатывают неточности, меняют некоторые движения или убирают их вовсе. Это делают уже вручную.

А как играть?

Работа актёров мокапа стоит отдельного упоминания, потому что им приходится отыгрывать грустные и веселые ситуации, стоя посреди переполненной людьми площадки, будучи обвешанными датчиками, да ещё и со всякими смешными предметами в придачу. Реквизит при записи мокапа весьма условный. Если это какой-то предмет, то важно для записи только положение рук и пальцев. Двери, мотоциклы и мебель часто сколачивают из фанеры, собирают из матовых трубок, картона, пластика и клейкой ленты. При этом их стараются сделать максимально прозрачными и ограничить число актёров на площадке, чтобы маркеры не терялись и не перекрывались чем-либо. Кроме того, чтобы ничего не помешало датчикам на костюме, весь реквизит должен быть матовым и не отражать свет.

Думать о том, что процесс мокапа — лёгкая и весёлая прогулка, точно не стоит. Сама по себе технология всё ещё требует усовершенствований и создаёт неудобства. Нередко съёмки эпизода затягиваются и превращаются в ужасную рутину с повторением одного и того же. В том числе поэтому сейчас уже чаще вместо Motion Capture говорят именно Performance Capture, подчёркивая роль актёров, которые вдыхают жизнь в модельки персонажей.

На Game Developers Conference 2016 года студия Ninja Theory показала доступность технологии с помощью демонстрации захвата движений в реальном времени. Ведущий на сцене общался с актрисой, исполнившей роль героини Hellblade: Senua's Sacrifice, и та реагировала на его слова. Конечно, она была ограничена в действиях и двигалась в большей степени по заготовленным шаблонам, однако это уже огромный шаг как для студии, которая в те времена насчитывала 15 сотрудников, так и для технологии в целом.

Кроме человеческих актёров, некоторые студии записывают мокап и у животных. Для Red Dead Redemption, например, делали захват движений лошадей, чтобы они двигались максимально реалистично. Для съёмок в вестерне позвали коня по имени Бланко, который часто терял датчики и заставлял переснимать дубли. Кроме этого, с него же писали и звук лошадей, а потому для общения каскадёра и режиссёра была разработана специальная система жестов. Один из них ужасно напоминал Бланко команду «встать на дыбы», так что каскадёру не раз приходилось вылетать из седла.

Для десятков игр записывали движения собак-компаньонов. В Call of Duty: Ghosts полноценная роль досталась овчарке Райли. Исполнил звёздную роль пёс-каскадёр Ругер. А прототипом Псины из Fallout 4 стала немецкая овчарка по кличке Ривер.

Технически с животными всё проходит точно так же, как с людьми — датчики считывают движения животного и передают костям на условной модели в компьютере. Различие лишь в том, что животному сложнее объяснить, что от него требуется в кадре. Но зато они выглядят в костюмах очаровательно!

Технология захвата движений — это не только крутая идея, изобретательная техническая реализация, невероятная сила воображения и труд десятков людей, но и некоторая магия, создающая новые миры с реальными людьми. Должно быть что-то волшебное и прекрасное в том, что познакомило нас с Артуром Морганом, Сэмом Бриджесом, андроидом Коннором, Элой, Кратосом и ещё десятками персонажей, в которых по-настоящему веришь. Даже если это давалось всем участникам процесса с огромным трудом.

А какая игра с технологией Motion Capture ваша любимая?